ハルシネーション(Hallucination)は、AIの生成モデルにおいて重要な概念です。ハルシネーションとは、モデルが訓練データには存在しない情報を生成する現象、幻覚のようなものを指します。ChatGPTなどの自然言語処理モデルでは、大規模なトレーニングデータを使用して学習されますが、それでもなお、生成されたテキストには時折、現実には存在しない情報や誤った情報が含まれることがあります。

ハルシネーションは、以下のような理由によって引き起こされることがあります。

学習データの不完全性

モデルが学習したデータは、実際の世界の表現を完全に網羅するものではない。そのため、モデルは訓練データに存在しない情報を生成する可能性があります。

隠れたパターンやバイアス

モデルは大量のデータから統計的なパターンを学習しますが、時にはそれによって隠れたバイアスや意味のない相関関係が学習されることがあります。その結果、ハルシネーションが発生する可能性があります。

入力の解釈の曖昧さ

モデルが人間の発話を解釈する際には、一部の情報が欠落していることや、文脈に関する曖昧さが存在することがあります。このような場合、モデルは不正確な情報を生成する可能性があります。

ハルシネーションを最小限に抑えるためには、以下のアプローチが有効です。

モデルのトレーニングデータの改善

モデルのトレーニングに使用するデータセットをより多様かつ包括的にすることで、ハルシネーションのリスクを減らすことができます。

フィルタリングとポストプロセッシング

生成されたテキストをフィルタリングし、不適切な情報やハルシネーションを検出・修正するための手法を導入することも有効です。

ユーザーのフィードバックと監督

ユーザーからのフィードバックを活用してモデルを改善し、生成される応答の品質を向上させることが重要です。

temperature(温度)のパラメーター

temperature(温度)のパラメーターを変更することで、結果のランダム性を制御し、これがGPT-3 のような言語モデルのハルシネーション(Hallucination)にも関与します。温度が低いと比較的予測可能な結果が得られますが、温度が高いと応答のランダム性が高まるため、ハルシネーション(Hallucination)が起こり、創造的な応答を生成する可能性が高くなります。

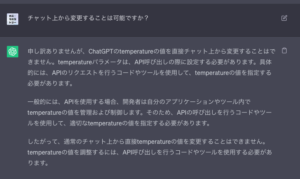

申し訳ありませんが、ChatGPTのtemperatureの値を直接チャット上から変更することはできません。temperatureパラメータは、API呼び出しの際に設定する必要があります。具体的には、APIのリクエストを行うコードやツールを使用して、temperatureの値を指定する必要があります。

一般的には、APIを使用する場合、開発者は自分のアプリケーションやツール内でtemperatureの値を管理および制御します。そのため、APIの呼び出しを行うコードやツールを使用して、適切なtemperatureの値を指定する必要があります。

したがって、通常のチャット上から直接temperatureの値を変更することはできません。temperatureの値を調整するには、API呼び出しを行うコードやツールを使用する必要があります。

なお、今回はChatGPTを介して言語モデルに直接チャット上(https://chat.openai.com/)から変更することは可能かと質問を行ったが、ChatGPTのtemperatureの値を直接チャット上から変更することはできず、API呼び出しを行うコードやツールを使う必要があるという回答が得られた。

ハルシネーションは、自然言語処理モデルの進化に伴い、改善されていくことが期待されています。しかし、現在の技術では完全に解決することは難しく、注意が必要です。

■2023年6月7日追記

なお、OpenAI は「ハルシネーション(Hallucination)」と改善するための新しい方法を追求しており、OpenAIの新しい調査報告書によるとOpenAIは、AIチャットボットが最終的な答えを出す前に、推論の正しいステップを処理するたびに自分に報酬を与えるように徹底的に訓練する、新しい戦略を実施する予定です。このプロセスは、「process supervision(プロセス監視)」と名付けられています。

なお、OpenAIはすでに、AIチャットボットが成功した正しい最終結果を生成するたびに自分に報酬を与えるように訓練する「outcome supervision(結果監視)」アプローチを実施していました。両者(process supervision(プロセス監視)、outcome supervision(結果監視))のアプローチは似ていますが、process supervision(プロセス監視)アプローチにより、AIチャットボットはより意識的で信頼性の高い結果を生成できるようになる。

(※AIモデルにおける「報酬(reward)」は、学習中にモデルに対して与えられるフィードバックの一種。報酬は、モデルが特定のタスクや目標を達成したときに与えられるポジティブな値。)