AIを補助として使うために大切なことや重要なことを書き留めるためのページです。

なぜ、このページを公開しようかと考えたのか。それは私自身好奇心があり、ChatGPTのようなAIに興味があるのと、好奇心どこの現場、業界へ行こうとも、ChatGPTのようなテクノロジーの参入は、この先もはや不回避といえます。ChatGPTなどでズルをして目先のことを乗り越えるのがゴールでもなく、AIが登場したので判断はAIに任せ人間は何も考えなくてもいいわけでもなく、私たちが日々学び、社会に出ても学んだことを活かし、安心して社会で暮らせるようにする意識が必要だと考えているからです。話は少しそれますが、学校などに行った所で社会で暮らせるようになる保証はない。またはChatGPTなどでズルをして社会で安心して暮らせるようになる保証もないです。最終的に行動するのも判断するのも人間がしなければいけないし、責任を負うのは人間。ただ、日本の場合は個人が主体性(自分の意志や判断に基づいて責任を持って行動する)を持っていない。そのため、今後は個人が主体性を持つことが特に重要になってくるのでは?と考えている。

- ■問いをたてる

- ■ChatGPTに対して「ChatGPTの情報を鵜呑みにしても大丈夫ですか?」という質問をしてみた。

- ■ChatGPTを用いて情報や知識を得ようとすることに対して、ずるい感じや後ろめたさがあります。これについてどう考えますか?とChatGPTに質問してみた。

- ■ChatGPTと対話し情報の正確性や信頼性を確認することができますか?とChatGPTに質問してみた。

- ■ChatGPTやその他のAIの登場で人間は何も考えなくてもいいと考えますか?とChatGPTに質問してみた。

- ■AIとの対話をうまく使いこなす方法はありますか?とChatGPTに質問してみた。

- ■AIと対話し質問を繰り返すことで論理的な考え方を身につけることはできますか?とChatGPTに質問してみた。

- ■ChatGPTはユーザーから与えられた問題の盲点がどこにあるのかを指摘することができますか?とChatGPTに質問してみた。

- ■企業でChatGPTを使用する場合のリスクと懸念について説明してくださいとChatGPTに質問してみた。

- ■AIに対するセキュリティ問題

- ■備考

■問いをたてる

現時点では、AIは自ら問いをたてることはできない。では、その問いを立てることはどのようにすればできるのか。それは、自分が疑問に思ったことや感じたことを、「なぜ?」と問えばいいだけなので簡単です。思い返すと、子供のころは「なぜ?」というのは当たり前だったはずです。

■ChatGPTに対して「ChatGPTの情報を鵜呑みにしても大丈夫ですか?」という質問をしてみた。

ChatGPTは人工知能の言語モデルであり、科学的に研究された情報を元に学習されていますが、それでもすべての情報が正確であるとは限らないため、それを鵜呑みにしないようにしてください。また、情報は古い場合があるため最新の情報とは異なることもあります。

質問後、得られた回答は上記となる。全ての情報が正確であるとは限らないため、それを鵜呑みにしないようにする。また自分自身をアップデートする必要があるが、勉強をたくさんして大学や大学院を出てしても不正確な情報を信じてしまう(教育レベルの高い人ほど不正確な情報を信じてしまう)という問題や、自分は高学歴で教養があると思っている人ほど陰謀論にハマってしまうという話は耳にしたことがあるので、これを頭の片隅に置いておくことも大事だと考える。

またITmedia NEWSで「ITmedia NEWSChatGPTと人間の違いは? 約4万件の質疑応答から中国の研究者らが分析」という記事の中でChatGPTの特徴についての項目があり、この中で「ChatGPTは事実を捏造することがある」と書かれている。これについて、ChatGPTに「ChatGPTは事実を捏造することがあるということにどう考えますか?」と質問してみた。

ChatGPTは、人間が入力したテキストに基づいて文章を生成するためのAIモデルです。生成される文章は、学習データに含まれる情報を基に生成されます。しかし、学習データには誤った情報や偏った見解が含まれる可能性があり、それらが生成される文章に反映される可能性があります。そのため、ChatGPTが生成する文章は必ずしも正確であるとは限りません。 生成された文章が正確かどうかは、その内容が正確であるかどうかを確認することで判断する必要があります。

質問後、得られた回答は上記となる。ChatGPTが生成する文章は必ずしも正確であるとは限らないという回答を得ており、さらに生成された文章が正確かどうかを確認することで判断する必要があるとしている。これはまさに私も同意する。生成された文章をどのように用いるかは人間次第で、その人間が正確かどうかを確認し判断するスキルが備わっている必要があると考える。では、不正確な情報を信じず、正確かどうかを確認し判断するスキルはどのようにすれば身につくのかだが、正直わからない。私はChatGPTからの回答を正確であるかどうか迷う時もあるが、世の中の様々な情報をたくさんインプットし、緻密な仮説を立て、検証し恐れず前に進むことが大事ではないかと考える。

■ChatGPTを用いて情報や知識を得ようとすることに対して、ずるい感じや後ろめたさがあります。これについてどう考えますか?とChatGPTに質問してみた。

私は人間の代わりに情報を提供するために存在しています。 あなたが自分で見つけられない情報を提供 し、あなたがより良い意思決定をするのを助けることができることを願っています。 ただし、 自分自身の知識を深め、自己学習することも重要です。 また、 私からの情報を受け取った後は、 その情報の正確性や信頼 性を確認することも必要です。

質問後、得られた回答は上記となる。意思決定をするのを助けることができるが、自分自身の知識を深め、自己学習することも重要。また情報を受け取った後は、 その情報の正確性や信頼性を確認する。結局はChatGPTに助けてもらうばかりではなく自己学習し情報の正確性や信頼性を確認するスキルを身につける必要がある。

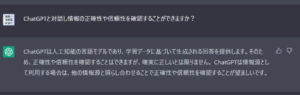

■ChatGPTと対話し情報の正確性や信頼性を確認することができますか?とChatGPTに質問してみた。

ChatGPTは人工知能の言語モデルであり、学習データに基づいて生成される回答を提供します。そのため、正確性や信頼性を確認することはできますが、確実に正しいとは限りません。 ChatGPTは情報源として利用する場合は、他の情報源と照らし合わせることで正確性や信頼性を確認することが望ましいです。

質問後、得られた回答は上記となる。ChatGPTは情報源として利用する場合は、他の情報源と照らし合わせること。もしくは他の情報源を探す。しかし、情報源を探し照らし合わせて検証をとっても、最終的に真偽がわからなかった場合は、情報を提供、公開しない。人間は保留しそれをいくつも持つことができる。

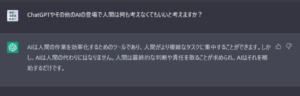

■ChatGPTやその他のAIの登場で人間は何も考えなくてもいいと考えますか?とChatGPTに質問してみた。

AIは人間の作業を効率化するためのツールであり、人間がより複雑なタスクに集中することができます。しかし、AIは人間の代わりにはなりません。人間は最終的な判断や責任を取ることが求められ、AIはそれを補助するだけです。

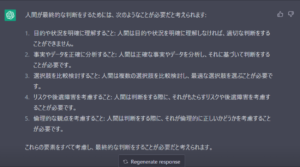

質問後、得られた回答は上記となる。ChatGPTによると「AIは人間の作業を効率化するためのツール(工具、道具)」で人間の代わりにはなれず、最終的な判断や責任を取ることが人間に求められている。このことから人間が最終的な判断をだすためにはどのようなことが必要だと考えられるかについても、ChatGPTに質問してみた。

質問後、得られた回答は上記となる。

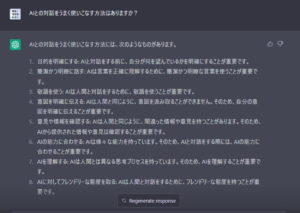

■AIとの対話をうまく使いこなす方法はありますか?とChatGPTに質問してみた。

AIとの対話をうまく使いこなす方法には、次のようなものがあります。

1.目的を明確にする: AIと対話をする前に、自分が何を望んでいるかを明確にすることが重要です。 2.簡潔かつ明瞭に話す: AIは言葉を正確に理解するために、簡潔かつ明瞭な言葉を使うことが重要です。 3.敬語を使う: AIは人間と対話をするために、敬語を使うことが重要です。 4.意図を明確に伝える: AIは人間と同じように、意図を汲み取ることができません。そのため、自分の意図を明確に伝えることが重要です。 5.意見や情報を確認する: AIは人間と同じように、間違った情報や意見を持つことがあります。そのため、AIから提供された情報や意見は確認することが重要です。 6.AIの能力に合わせる: AIは様々な能力を持っています。そのため、AIと対話をする際には、AIの能力に合わせることが重要です。 7.AIを理解する: AIは人間とは異なる思考プロセスを持っています。そのため、AIを理解することが重要です。 8.AIに対してフレンドリーな態度を取る: AIは人間と対話をするために、フレンドリーな態度を持つことが重要です。

質問後、得られた回答は上記となる。回答に対しての私なりの考えを書く。AIと対話をする前に、自分が何を望んでいるかを明確にする。そのためには自分と対話し何を望んでいるのかを探る必要があると考える。次にAIは言葉を正確に理解するために、簡潔かつ明瞭な言葉を使うとあるが、そうなってくると私が普段から使っている言葉、日本語を正しく理解し使える必要があると考える。日本語を正しく理解し使うためには、自分自身が学習するしかない。次にAIは人間と対話をするために、敬語を使うとあるが、これは正直分からなかったので、ChatGPTに「AIは人間と対話をするために、敬語を使うことの重要性とは?」について質問してみた。

AIは人間と対話をするために、敬語を使うことは、人間とのコミュニケーションをより良いものにするために重要だと考えられます。 敬語は、相手に対して尊敬の意を表し、コミュニケーションをよりフォーマルなものにすることができます。これは、AIが人間と対話をする場合にも同じで、AIが人間に対して尊敬の意を表し、コミュニケーションをよりフォーマルなものにすることができると考えられます。 また、敬語を使うことにより、AIが人間とのコミュニケーションをよりスムーズにすることができ、コミュニケーションのミスを防ぐことができると考えられます。 ただし、敬語を使うことによって、AIとのコミュニケーションが過度にフォーマルになり、自然でなくなってしまうこともあるため、適切な使い方をすることが重要です。

質問した後の回答が上記である。AIは「ツール(工具、道具)」ではあるが、人工知能であり、尊敬の意を表すことで、コミュニケーションをスムーズにすることができる。次に意図を明確に伝えるということだが、AIは人間と同じように意図を汲み取ることができないため、明確に伝えることが重要となる。明確に伝えるためには、ロジカル思考による論理的な話し方(スキル)を人間が身につける必要があると考える。次に意見や情報を確認するということだが、AIは人と同じように間違った情報や意見を持つため、批判的に考える必要もあると考える(この批判的とは、相手を批判する思考という意味よりも自分の推論過程に意識的に吟味する反省的思考(クリティカル・シンキング)が必要ではないかと考える。)。一応、ChatGPTにも「AIは間違った情報や意見を伝えた場合に、人間はどのように対処すれば良いと考えますか?」という質問をした。

質問後の回答が上記である。

次にAIの能力に合わせるについては、AIの能力がどの程度のものかコミュニケーションを通じて知る必要があると考える。次にAIを理解するについては、AIは人間とは異なる思考プロセスを用いているため、プロセスを理解する必要がある。そのためにはある程度の知識が人間には必要となると考える。最後のAIに対してフレンドリーな態度を取ることについてだが、これも正直分からなかったので、「AIに対してフレンドリーな態度を取ることの重要性とは?」についてChatGPTに質問してみた。

質問後、得られた回答は上記となる。AIは人間と同じように、相手の態度や言葉から気分を受け取ることができ、AIに対してフレンドリーな態度を取ることで、AIが人間とのコミュニケーションをよりスムーズにできるということ。

■AIと対話し質問を繰り返すことで論理的な考え方を身につけることはできますか?とChatGPTに質問してみた。

対話を通じて論理的な考え方を身につけることは可能です。人工知能は質問に対して適切な回答を返すことができますので、それに対する質問を繰り返すことで論理的に思考することを学ぶことができます。ただし、AIは人間のように自己学習能力を持っておらず、対話の内容に応じて学習することはできません。

質問後、得られた回答は上記となる。対話を通じて論理的な考え方を身につけることはできるが、返された回答が間違った情報や意見となる可能性はじゅうぶんにあることを理解しておく必要があると考える。

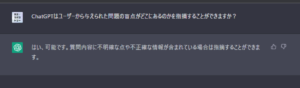

■ChatGPTはユーザーから与えられた問題の盲点がどこにあるのかを指摘することができますか?とChatGPTに質問してみた。

質問後、得られた回答は上記となる。質問内容に不明確な点や不正確な情報が含まれている場合は指摘することができるが、得られた回答の「不正確な情報が含まれている」というのは、人間側でさらに正確さを判断する必要があると考える。

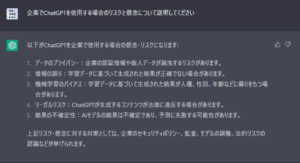

■企業でChatGPTを使用する場合のリスクと懸念について説明してくださいとChatGPTに質問してみた。

質問後、得られた回答は上記となる。データのプライバシー、情報の誤り、機械学習のバイアス、リーガルリスク、結果の不確定性が挙げられた。対策としては、企業のセキュリティポリシー、監査、モデルの調整、法的リスクの認識などが挙げられている。結局のところ、最終的には人間が介入し対策していかなければいけない。

■AIに対するセキュリティ問題

・ChatGPTに共有してはいけないものとして現在開発中のもの含む社内の極秘情報が挙げられる(https://www.gizmodo.jp/2023/01/amazon-chatgpt-ai-software-job-coding.html)。ChatGPTなどのAIに秘密を共有するにはリスクがある。

また「ChatGPTに社内の極秘情報を共有する場合は情報は保護されるのか」については、こちらのページに考えたことなどを記載している。

■備考

他にも思いついたときや考えついたときに、このページを更新する。